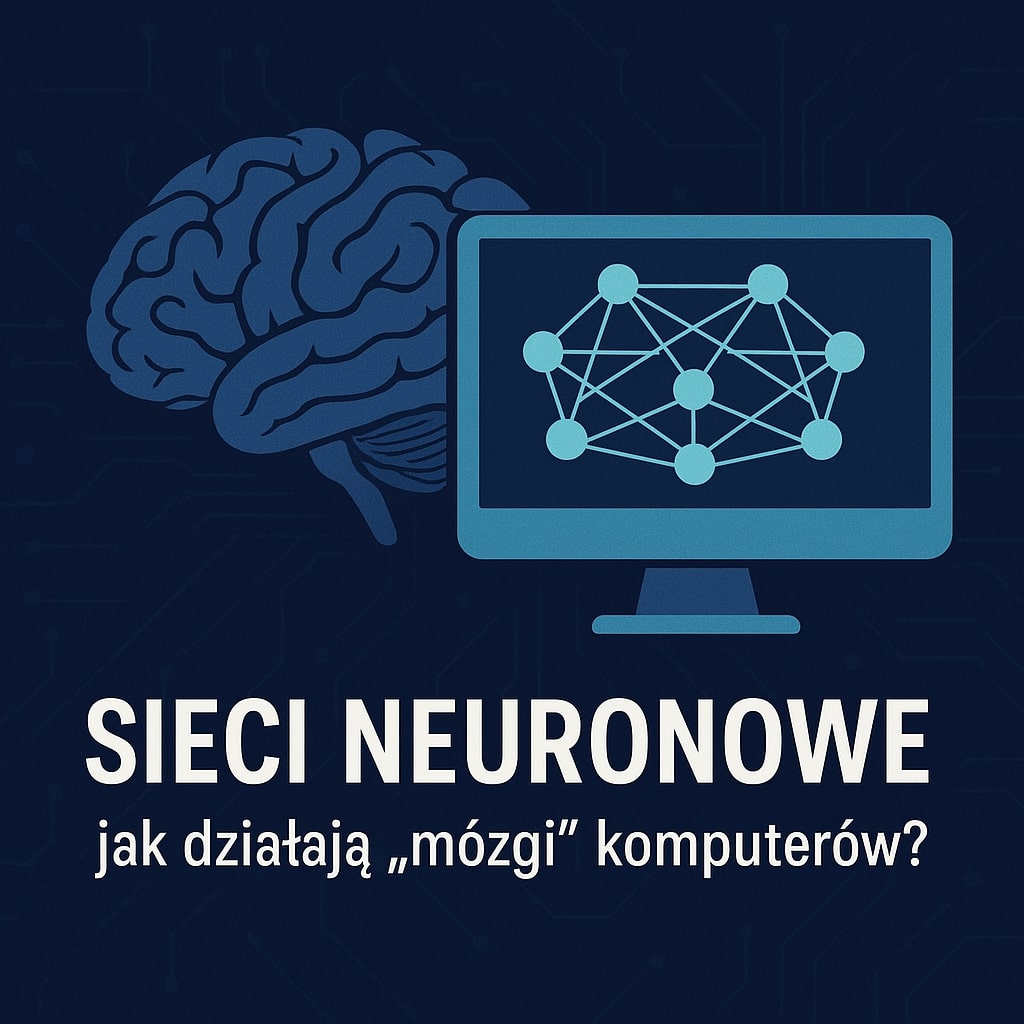

Sieci neuronowe – jak działają „mózgi” komputerów?

Sieci neuronowe to obecnie fundament rewolucji technologicznej, którą obserwujemy. To one stoją za sukcesami takich narzędzi jak ChatGPT, systemy rozpoznawania twarzy w telefonach czy autonomiczne samochody Tesli. Choć brzmią jak koncepcja z literatury science-fiction, ich działanie opiera się na matematyce, statystyce i biologicznych inspiracjach.Sieci neuronowe to obecnie fundament rewolucji technologicznej, którą obserwujemy. To one stoją za sukcesami takich narzędzi jak ChatGPT, systemy rozpoznawania twarzy w telefonach czy autonomiczne samochody Tesli. Choć brzmią jak koncepcja z literatury science-fiction, ich działanie opiera się na matematyce, statystyce i biologicznych inspiracjach.

Spis treści

1. Biologiczna inspiracja: Od neuronu do kodu

Sztuczne sieci neuronowe (ANN – Artificial Neural Networks) zostały zainspirowane budową ludzkiego mózgu. W naszych głowach miliardy neuronów przesyłają sygnały elektryczne przez synapsy. Jeśli sygnał jest wystarczająco silny, kolejny neuron „odpala”.

W świecie informatyki neuron to funkcja matematyczna. Przyjmuje ona dane wejściowe, przetwarza je i decyduje, czy przekazać wynik dalej.

2. Anatomia sztucznego neuronu

Aby zrozumieć sieć, musimy spojrzeć na jej najmniejszy element. Każdy sztuczny neuron składa się z czterech głównych komponentów:

- Wejścia ($x$): Dane, które otrzymujemy (np. jasność konkretnego piksela w obrazie).

- Wagi ($w$): To najważniejszy element. Wagi określają, jak istotne jest dane wejście. Nauka sieci polega właśnie na korygowaniu tych wag.

- Bias (obciążenie/błąd): Dodatkowa wartość pozwalająca modelowi na elastyczność (przesunięcie funkcji aktywacji).

- Funkcja aktywacji: Decyduje, czy neuron powinien zostać „aktywowany”. Najpopularniejszą funkcją jest ReLU (zamienia wartości ujemne na zero) lub Sigmoid.

Matematycznie pojedynczy neuron wykonuje operację:

$$y = f(\sum_{i=1}^{n} (w_i \cdot x_i) + b)$$

Gdzie $f$ to funkcja aktywacji.

3. Struktura sieci: Warstwy i ich rola

Sieć neuronowa nie pracuje w izolacji – neurony są zorganizowane w warstwy.

- Warstwa wejściowa (Input Layer): Tu trafiają surowe dane. Każdy neuron odpowiada za jedną cechę (np. jeden piksel).

- Warstwy ukryte (Hidden Layers): To tutaj dzieje się „magia”. Warstw może być od kilku do tysięcy (wtedy mówimy o Deep Learningu). Każda kolejna warstwa wyciąga bardziej złożone wnioski z poprzedniej.

- Warstwa wyjściowa (Output Layer): Zwraca ostateczny wynik, np. „To jest zdjęcie kota z prawdopodobieństwem 98%”.

4. Proces uczenia, czyli jak sieć zdobywa wiedzę

Sieć neuronowa na początku nie wie nic. Jej wagi są ustawione losowo. Proces nauki składa się z dwóch powtarzających się etapów:

Propagacja w przód (Forward Propagation)

Dane płyną od wejścia do wyjścia. Sieć zgaduje wynik. Na początku niemal zawsze się myli.

Propagacja wsteczna (Backpropagation)

To moment „wyciągania wniosków”. Algorytm porównuje wynik sieci z poprawną odpowiedzią. Obliczany jest koszt (Loss Function), czyli błąd, jaki popełniła sieć. Następnie informacja o błędzie wraca przez sieć od tyłu, a wagi są korygowane tak, aby przy następnej próbie błąd był mniejszy.

5. Optymalizacja i „Schodzenie po gradiencie”

Wyobraź sobie, że stoisz na szczycie góry we mgle i chcesz zejść do najniższej doliny (gdzie błąd sieci jest najmniejszy). Nie widzisz celu, ale czujesz pod stopami nachylenie terenu.

Gradient Descent (Stochastyczne schodzenie po gradiencie) to technika, dzięki której sieć decyduje, w którą stronę i o ile zmienić wagi, aby „zejść” do minimum błędu.

6. Rodzaje sieci neuronowych do zadań specjalnych

Nie każda sieć jest taka sama. Architektura zależy od problemu:

| Typ sieci | Zastosowanie | Cecha charakterystyczna |

| CNN (Splotowe) | Obrazy, wideo | Posiadają filtry wykrywające krawędzie i kształty. |

| RNN (Rekurencyjne) | Tekst, mowa, giełda | Mają „pamięć” – biorą pod uwagę kolejność danych. |

| Transformery | Tłumaczenia, LLM | Analizują relacje między wszystkimi słowami w zdaniu jednocześnie. |

7. Dlaczego teraz? Trzy filary sukcesu

Choć koncepcja sieci neuronowych powstała w latach 50. XX wieku, ich prawdziwy rozkwit nastąpił dopiero niedawno dzięki:

- Dostępowi do Big Data: Mamy miliardy zdjęć i tekstów do nauki.

- Mocy GPU: Karty graficzne potrafią liczyć tysiące operacji na raz, co jest idealne dla sieci neuronowych.

- Innowacjom w algorytmach: Opracowanie lepszych funkcji aktywacji i metod optymalizacji.

8. Wyzwania: Ciemna strona „czarnej skrzynki”

Mimo swojej potęgi, sieci neuronowe mają wady:

- Brak interpretowalności: Trudno zrozumieć, dlaczego sieć podjęła daną decyzję.

- Halucynacje: Modele mogą generować bardzo przekonujące, ale błędne informacje.

- Koszty: Trenowanie największych modeli (jak GPT-4) kosztuje miliony dolarów i zużywa ogromne ilości energii.

Ważne: Sieć neuronowa nie „myśli” w ludzkim znaczeniu tego słowa. Nie posiada świadomości ani zrozumienia świata. Jest niezwykle zaawansowanym kalkulatorem statystycznym, który znajduje wzorce w liczbach.