Big Data a AI – jaka jest relacja?

Spis treści

1. Wprowadzenie: Dwa filary rewolucji technologicznej

Współczesna rewolucja technologiczna opiera się na dwóch kluczowych filarach: Big Data i sztucznej inteligencji. Te dwa pojęcia są ze sobą nierozerwalnie związane – AI potrzebuje danych do nauki, a Big Data wymaga zaawansowanych algorytmów do przetwarzania. Zrozumienie tej relacji jest kluczowe dla każdego, kto chce pojąć, jak działa nowoczesna technologia.

W tym artykule wyjaśnię, czym właściwie jest Big Data, jak się ma do AI, i dlaczego ich symbiotyczna relacja napędza współczesną rewolucję technologiczną.

2. Czym jest Big Data?

Big Data to termin opisujący ogromne zbiory danych, które są zbyt duże lub złożone, by przetwarzać je tradycyjnymi metodami. Mówiąc prościej – to więcej informacji niż jesteśmy w stanie sensownie przetworzyć bez specjalistycznych narzędzi.

Big Data charakteryzuje się trzema głównymi cechami (tzw. „3V”):

Volume (Objętość) – mówimy o petabajtach i eksabajtach danych. Dla porównania, jeden petabajt to około 13 lat filmów w jakości HD.

Velocity (Prędkość) – dane napływają w czasie rzeczywistym z milionów źródeł jednocześnie. Media społecznościowe generują setki tysięcy postów na sekundę.

Variety (Różnorodność) – dane przychodzą w różnych formatach: tekst, obrazy, wideo, dane sensoryczne, logi systemowe. Nie są to uporządkowane tabele, ale chaotyczna mieszanka formatów.

Źródła Big Data to między innymi: media społecznościowe, sensory IoT, transakcje finansowe, logi serwerów, dane medyczne, czy nawet dane satelitarne.

3. Czym jest sztuczna inteligencja?

Sztuczna inteligencja to dziedzina nauki zajmująca się tworzeniem systemów zdolnych do wykonywania zadań wymagających ludzkiej inteligencji. AI potrafi rozpoznawać wzorce, uczyć się z doświadczeń i podejmować decyzje.

Kluczowe poddziedziny AI to:

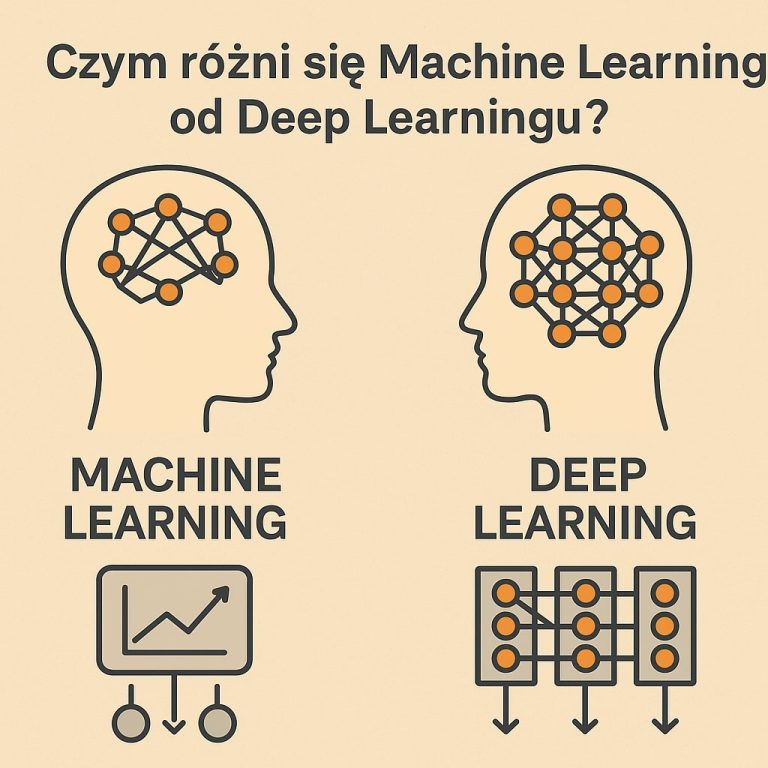

Machine Learning – systemy uczące się na podstawie danych bez jawnego programowania każdej reguły.

Deep Learning – wykorzystanie wielowarstwowych sieci neuronowych do rozwiązywania złożonych problemów.

NLP (Natural Language Processing) – przetwarzanie i rozumienie języka naturalnego.

Computer Vision – analiza i interpretacja obrazów oraz wideo.

Więcej o podstawach AI możesz przeczytać w naszym artykule: Czym jest sztuczna inteligencja.

4. Big Data jako paliwo dla AI

Relację między Big Data a AI można porównać do relacji między benzyną a silnikiem samochodowym. Bez danych AI jest bezużyteczna – to właśnie na danych algorytmy się uczą i doskonalą.

Dlaczego AI potrzebuje Big Data:

Modele uczenia maszynowego wymagają ogromnych ilości przykładów, by nauczyć się rozpoznawać wzorce. Large Language Models jak GPT były trenowane na setkach miliardów słów. Modele rozpoznawania obrazów jak ResNet wymagały milionów zaetykietowanych zdjęć.

Im więcej danych, tym lepsze wyniki. To zjawisko nazywa się emergencją – nowe zdolności pojawiają się w dużych modelach, których nie było w małych.

Proces uczenia:

Dane treningowe są podstawą – na nich model uczy się rozpoznawać wzorce. Następnie dane walidacyjne służą do dostrajania parametrów. Wreszcie dane testowe sprawdzają, jak model radzi sobie z nieznanymi informacjami.

5. AI jako narzędzie do przetwarzania Big Data

Z drugiej strony, Big Data bez AI to po prostu góra bezużytecznych informacji. Ludzki mózg nie jest w stanie przetworzyć petabajtów danych – potrzebujemy zaawansowanych algorytmów.

Jak AI pomaga w analizie Big Data:

Uczenie nienadzorowane pozwala znajdować ukryte wzorce w danych bez etykiet. Firmy e-commerce używają tego do segmentacji klientów.

Uczenie nadzorowane służy do przewidywania na podstawie oznaczonych przykładów – od przewidywania rezygnacji klientów po wykrywanie oszustw.

Deep learning radzi sobie z najbardziej złożonymi danymi – obrazami, wideo, mową. CNN analizują zdjęcia medyczne, RNN przetwarzają serie czasowe.

6. Kluczowe technologie łączące Big Data i AI

Infrastruktura obliczeniowa:

GPU (procesory graficzne) umożliwiły rewolucję w deep learningu, przyspieszając obliczenia nawet tysiąckrotnie. TPU (Tensor Processing Units) od Google to specjalistyczne procesory zaprojektowane wyłącznie do trenowania sieci neuronowych.

Distributed training pozwala trenować modele na setkach GPU jednocześnie. Superkomputery składające się z tysięcy procesorów trenują największe modele jak GPT-4.

Przechowywanie i przetwarzanie danych:

Data lakehouse to nowoczesna architektura łącząca elastyczność jezior danych z strukturą hurtowni. Vector databases przechowują embeddingi – matematyczne reprezentacje danych używane przez modele AI.

ETL/ELT to procesy przygotowania danych do analizy. Feature engineering to sztuka wybierania i tworzenia cech, które model będzie analizował.

7. Praktyczne zastosowania synergii Big Data i AI

E-commerce i marketing:

Systemy rekomendacji jak Netflix czy Amazon analizują miliardy interakcji użytkowników. Personalizacja treści działa w czasie rzeczywistym dla każdego odwiedzającego. Predictive analytics przewiduje, co kupisz, zanim sam o tym pomyślisz.

Finanse:

Algorithmic trading analizuje terabajtów danych rynkowych w milisekundach. Wykrywanie oszustw w czasie rzeczywistym chroni miliony transakcji dziennie. Ocena ryzyka kredytowego wykorzystuje tysiące zmiennych zamiast kilku podstawowych wskaźników.

Medycyna:

Bioinformatyka analizuje genomowe bazy danych zawierające petabajty informacji. AlphaFold przewiduje strukturę białek, rewolucjonizując biologię molekularną. Diagnostyka obrazowa wykorzystuje miliony opisanych przypadków do uczenia się rozpoznawania chorób.

Transport:

Pojazdy autonomiczne generują terabajty danych sensorycznych dziennie. Optymalizacja tras dla flot pojazdów analizuje dane o ruchu w czasie rzeczywistym. Predictive maintenance przewiduje awarie przed ich wystąpieniem.

8. Wyzwania w łączeniu Big Data z AI

Jakość danych:

Garbage in, garbage out – model jest tak dobry, jak dane na których się uczy. Data cleaning to żmudny proces usuwania błędów i niespójności. Bias w danych prowadzi do stronniczych modeli – to poważny problem etyczny.

Prywatność i bezpieczeństwo:

Privacy-preserving AI to techniki chroniące prywatność podczas trenowania. Federated learning pozwala uczyć się na rozproszonych danych bez ich kopiowania. Anonymization usuwa dane osobowe ze zbiorów treningowych.

Koszty i złożoność:

Trenowanie największych modeli kosztuje miliony dolarów. Compute governance staje się kwestią geopolityczną. Wymaga to specjalistycznej wiedzy i doświadczenia – nie każda firma może sobie na to pozwolić.

9. Przyszłość relacji Big Data i AI

Trendy technologiczne:

Small Language Models – trend tworzenia wydajnych modeli mieszczących się w telefonie. Synthetic data generation redukuje zależność od prawdziwych danych. Neuromorphic computing – sprzęt naśladujący strukturę mózgu może zmienić zasady gry.

Demokratyzacja dostępu:

AI as a Service udostępnia zaawansowane modele przez API. Edge AI przenosi przetwarzanie na urządzenia końcowe. Open source AI sprawia, że technologia staje się dostępna dla wszystkich.

Nowe możliwości:

Agentic AI – autonomiczne systemy wykonujące złożone zadania. World simulators – modele symulujące fizykę rzeczywistości. AGI readiness – przygotowanie na nadejście sztucznej inteligencji ogólnej.

10. Podsumowanie: Symbiotyczna relacja kształtująca przyszłość

Big Data i AI to nie dwie oddzielne technologie – to nierozerwalnie związany ekosystem. AI potrzebuje Big Data do nauki, a Big Data wymaga AI do przetwarzania. Ta symbiotyczna relacja napędza współczesną rewolucję technologiczną.

Dla organizacji oznacza to konieczność inwestowania w obie te obszary jednocześnie. Same dane bez zdolności ich przetwarzania są bezużyteczne. Najlepsze algorytmy bez danych pozostają teoretyczne.

Przyszłość należy do tych, którzy potrafią skutecznie łączyć te dwa światy – zbierać, przechowywać i przygotowywać dane, a następnie wykorzystywać AI do wydobywania z nich wartości. To właśnie ta kombinacja tworzy prawdziwą przewagę konkurencyjną w erze cyfrowej.